내 PC/서버에 직접 설치해 텔레그램·디스코드로 제어하는 셀프호스팅 AI 에이전트 플랫폼입니다.

외부 서버 없이 로컬 환경에서 Claude, GPT 등 LLM을 연결해 나만의 AI 직원을 구성할 수 있습니다.

"Claude를 쓸까, GPT를 쓸까, Gemini는 또 뭐가 다른 걸까?" — OpenClaw를 어느 정도 써본 분이라면 누구나 한 번쯤 이 선택의 기로에 서게 됩니다. 무조건 비싸고 똑똑한 모델을 기본으로 설정하자니 API 요금 폭탄이 두렵고, 저렴한 모델만 고집하자니 엉뚱한 대답에 실망할 것 같습니다.

이번 21편에서는 openclaw 모델 설정을 처음부터 끝까지 다룹니다. 2026년 현재 AI 에이전트 생태계를 이끄는 Claude·GPT·Gemini 3대장의 특성을 명쾌하게 비교하고, 비용과 성능을 모두 잡는 하이브리드 설정법까지 실전 코드와 함께 마스터하실 수 있습니다.

지난 편(20편: MCP(Model Context Protocol) 연동 — 외부 데이터 연결 완전 가이드)에서는 코딩 없이 외부 데이터 소스를 AI와 연결하는 MCP 방법을 배웠습니다. 이번 편에서는 그 연결된 시스템을 실제로 가장 효율적으로 구동할 AI 두뇌(모델)를 선택하고 설정하는 법을 다룹니다.

3대장 모델 비교 — 내 업무에 맞는 AI 두뇌 찾기

OpenClaw는 10여 개 이상의 LLM 제공자(Provider)를 지원합니다. 그 중에서도 실무에서 가장 자주 쓰이는 Claude·GPT·Gemini의 특성을 정확히 파악하면, 작업 유형에 따라 최적의 모델을 골라 쓰는 진정한 AI 에이전트 만들기가 가능해집니다.

Anthropic — Claude 시리즈

코딩과 도구 사용(Tool calling) 능력에서 현재 1위를 달리는 모델입니다. Claude Sonnet 4는 입력 $3 / 출력 $15(100만 토큰 기준)의 합리적인 가격으로, 성능과 비용의 밸런스가 가장 완벽합니다. OpenClaw 에이전트의 기본 모델(primary)로 가장 강력히 추천하는 선택입니다. 더 복잡한 프로덕션급 코딩·분석이 필요한 때만 비싼 Opus 4.5를 선택적으로 활용하세요.

OpenAI — GPT 시리즈

무난한 성능과 빠른 응답 속도가 강점입니다. 특히 GPT-5 Nano 같은 소형 모델은 1회 호출 비용이 극도로 저렴하여, 단순 반복 작업이나 백그라운드에서 주기적으로 실행되는 Heartbeat(심장박동) 용도로 쓸 때 그 가치가 빛을 발합니다.

Google — Gemini 시리즈

압도적인 컨텍스트 윈도우(문맥 길이)가 최대 무기입니다. Gemini 3 Pro는 100만 토큰 이상의 문맥을 한 번에 처리할 수 있어, 방대한 PDF 문서나 거대한 소스코드 전체를 통째로 던져주고 분석시킬 때 다른 모델의 추종을 불허합니다.

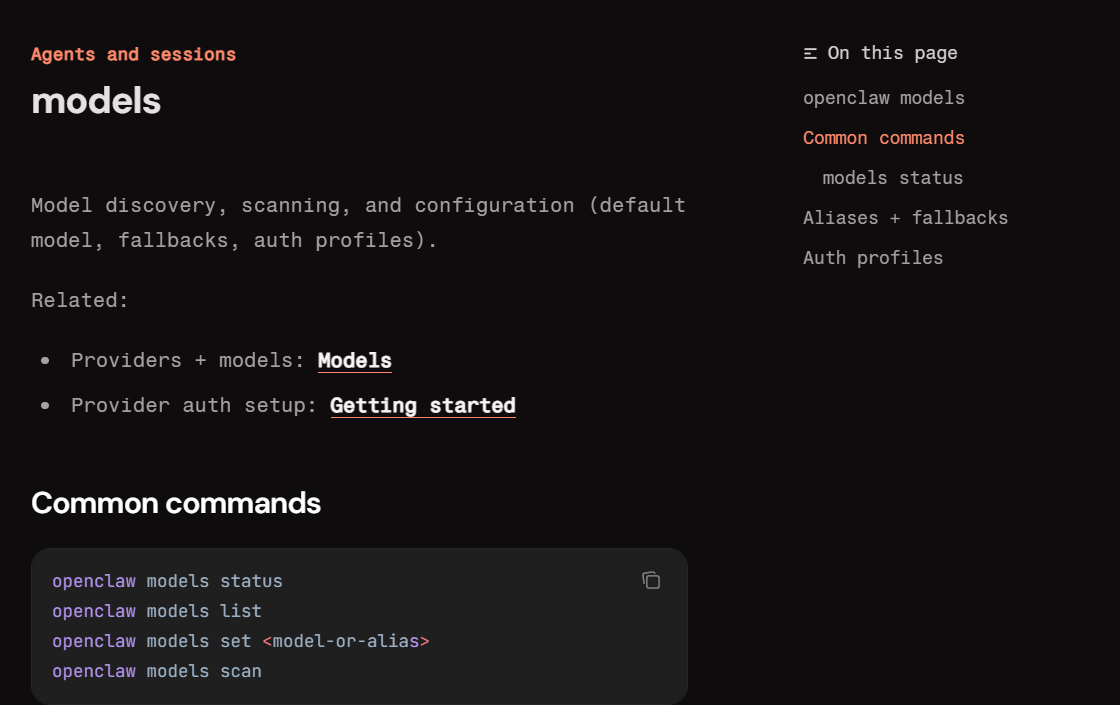

📎 공식 문서 원문 보기 →

가성비 극대화 전략 — Coordinator vs Worker 패턴

초보자들이 가장 많이 하는 실수는 '가장 똑똑하고 비싼 모델(Opus 4.5 등)을 기본 모델(Default)로 설정'하는 것입니다. 이렇게 하면 AI가 단순히 "네, 알겠습니다"라고 대답하는 데에도 비싼 요금을 내게 됩니다. 최고의 openclaw 사용법은 역할에 따라 모델을 분리하는 것입니다.

역할 분리의 핵심 원칙

- Primary(기본 대화·지시 처리): 가성비 좋은 Claude Sonnet을 전면에 배치합니다. 일상적인 대화·문서 작성·코드 리뷰 등 대부분의 업무를 이 모델이 담당합니다.

- Heartbeat(백그라운드 자율 작업): 스스로 깨어나 작업하는 heartbeat는 반드시 GPT-5 Nano 같은 초저가 모델을 배정합니다. 요금의 대부분이 여기서 새어나가는 경우가 많습니다.

- Fallbacks(장애 대비 대체 모델): 기본 모델이 오류나 속도 제한에 걸렸을 때 자동으로 전환되는 안전망입니다. 시스템이 멈추지 않도록 최소 2개 이상 설정하세요.

실전 설정 가이드 — openclaw.json 모델 설정 작성법

터미널을 열고 ~/.openclaw/openclaw.json 파일을 수정합니다. 아래 순서대로 따라 하시면 10분 내에 최고의 가성비 모델 라인업 설정이 완료됩니다.

- 설정 파일 열기선호하는 편집기로 설정 파일을 엽니다. nano 또는 VS Code 모두 가능합니다.

nano ~/.openclaw/openclaw.json- agents.defaults.model 블록 작성기본 모델, fallbacks 배열, heartbeat 전용 모델을 아래 예시대로 구성합니다.

{ "agents": { "defaults": { "model": { "primary": "anthropic/claude-sonnet-4-5", "fallbacks": [ "openrouter/openai/gpt-5-mini", "openrouter/google/gemini-3-flash-preview" ] }, "heartbeat": { "model": "openrouter/openai/gpt-5-nano" } } }, "provider": { "type": "anthropic", "apiKey": "${ANTHROPIC_API_KEY}" } }- 환경 변수 파일에 API 키 저장설정 파일에 API 키를 직접 적지 않고,

.env파일에 분리하여 보관합니다. # ~/.openclaw/.env 파일에 실제 키 값 입력 ANTHROPIC_API_KEY=sk-ant-xxxxxxxxxxxxx- 게이트웨이 재시작으로 설정 반영저장 후 아래 명령어로 게이트웨이를 재시작하면 새 모델 설정이 즉시 적용됩니다.

openclaw gateway restart

openclaw gateway restart 후 에이전트와 직접 대화해서 "지금 어떤 모델을 쓰고 있어?" 라고 물어보세요. 설정이 정상 반영되었는지 바로 확인할 수 있습니다.운영 안정화 — fallbacks·환경변수·비용 관리

모델 설정은 한 번 잡는 것으로 끝이 아닙니다. 장기 운영에서는 fallbacks의 순서, API 키 보안, 비용 모니터링이 에이전트의 안정성과 직결됩니다.

fallbacks 설정 시 우선순위 원칙

fallbacks 배열의 순서가 곧 전환 우선순위입니다. 기본 모델과 가장 성능이 비슷한 모델을 첫 번째 대체재로, 그다음엔 더 저렴하고 빠른 모델 순으로 나열하세요. 에러 상황에서도 가능한 한 품질을 유지하다가 최악의 경우 저비용 모델로 낙착되는 구조가 이상적입니다.

heartbeat에 고가 모델을 배정하면 백그라운드 자율 실행이 반복될 때마다 요금이 폭증합니다. Heartbeat 모델은 반드시 1회 호출 비용이 0.1원 미만인 초저가 모델(GPT-5 Nano 등)로 고정하세요.// 권장 fallbacks 순서 예시

"fallbacks": [

"openrouter/openai/gpt-5-mini", // 1순위: 가성비 대체재

"openrouter/google/gemini-3-flash-preview" // 2순위: 속도 최우선

]

실전 팁과 주의사항

- 처음엔 Claude Sonnet 하나로 시작: 모델 선택에 고민이 많다면 Claude Sonnet 4 하나만 설정하고 운영해 보세요. 80% 이상의 업무를 가장 안정적으로 처리하며, 이후 필요에 따라 조금씩 구조를 확장하면 됩니다.

- fallbacks 없이 운영하면 장애 = 서비스 중단: API 제공사 서버 장애나 속도 제한은 언제든 발생할 수 있습니다. 최소 1개 이상의 fallback 모델을 반드시 설정해 두세요.

- API 키는 절대 설정 파일에 하드코딩 금지: 설정 파일을 백업하거나 Git에 올리다가 키가 유출되는 사고가 빈번합니다.

"${ENV_VAR}"형태의 환경 변수 참조를 항상 사용하세요. - 월별 API 비용을 모니터링하세요: 각 제공사 대시보드에서 사용량 알림을 설정해 두면 예상치 못한 요금 폭탄을 사전에 방지할 수 있습니다.

자주 묻는 질문 (FAQ)

- 모델 종류가 너무 많아서 복잡해요. 딱 하나만 추천해 주신다면요?

- 고민 없이 Claude Sonnet 4를 추천합니다. 성능은 최고급 모델에 육박하면서도 가격은 합리적이라, 코딩부터 일상 문서 작성까지 80% 이상의 작업을 가장 안정적으로 처리합니다. 일단 Sonnet으로 시작하고 필요에 따라 조정해 보세요.

- fallbacks에 여러 모델을 적으면 요금이 이중으로 나가나요?

- 아닙니다. fallbacks 배열에 여러 모델을 적어둔다고 해서 모두 동시에 실행되지 않습니다. 기본 모델(Primary)이 에러가 나거나 속도 제한에 걸렸을 때만 다음 순번 모델로 자동 전환되는 안전장치 역할을 하므로 요금이 중복 청구되지 않습니다.

- API 키를 openclaw.json에 그냥 적어두면 위험한가요?

- 네, 매우 위험합니다. 설정 파일을 백업하거나 GitHub에 올리다가 키가 유출되는 사고가 빈번합니다. 본문 예제처럼

"${ANTHROPIC_API_KEY}"형태로 환경 변수를 참조하고, 실제 키 값은~/.openclaw/.env파일에만 보관하세요. - 갑자기 지난달보다 API 요금이 크게 늘었어요. 왜 그런가요?

- 백그라운드에서 주기적으로 실행되는 Heartbeat 기능에 고가 모델이 연결되어 있거나, 에이전트가 에러를 반복하며 무한 재시도를 했을 가능성이 큽니다. Heartbeat 모델은 반드시 GPT-5 Nano 같은 초저가 모델로 지정하고, 각 API 제공사 대시보드에서 월별 사용량 알림을 설정해 두세요.

이 글이 도움이 됐다면 댓글로 여러분의 경험을 알려주세요! 🙌

openclaw 모델 설정에서 막히는 부분은 댓글에 남겨주세요 — 직접 답변드립니다.

📬 새 편 알림 받기 → AI 활용 가이드 구독

'OpenClaw' 카테고리의 다른 글

| 오픈클로 완전 가이드 23편 Gateway 설정 완전 가이드 — 포트·토큰·데몬 상시 실행 (0) | 2026.04.08 |

|---|---|

| 오픈클로 완전 가이드 22편 로컬 LLM(Ollama) + OpenClaw 연동 — 완전 무료 AI 에이전트 구축 (0) | 2026.04.07 |

| 오픈클로 가이드 20편 openclaw MCP 연동 — 외부 데이터 연결 완전 가이드 (0) | 2026.04.04 |

| 오픈클로 완전 가이드 19편 커스텀 Tool 만들기 — Python 스크립트를 AI 도구로 등록하는 법 (1) | 2026.04.04 |

| 오픈클로 완전 가이드 18편 openclaw Tools & Plugins 전체 가이드 — AI가 쓸 수 있는 도구 추가하기 (0) | 2026.04.04 |

댓글